「robots.txt で拒否しているはずの AI クローラーが、なぜか毎日数百万リクエスト飛んできている」――コーポレートサイトや自社メディアの運用者から、こうした悲鳴をよく聞くようになりました。

Cloudflare が公式ブログで発表した AI Labyrinth は、この問題に対する攻めの防御です。ブロックするのではなく、AI 生成のダミーページで構成された”迷路”にクローラーを誘い込み、計算リソースを浪費させるという発想で、Free プランを含む全顧客向けに opt-in で提供されています。

本記事では、AI Labyrinth のアーキテクチャ、SEO への配慮、ハニーポットとしての副次効果、そして中小企業のコーポレートサイト・オウンドメディアにどう効くのかを、実装担当者の目線で整理します。

なぜ今「迷路」なのか ― 無断学習クローラーの規模感

Cloudflare のネットワークには、1 日 500 億件を超える AI クローラーリクエストが届いており、全トラフィックの約 1% を占めると発表されています。

従来の対策は次の 3 段構えでした。

- robots.txt で “Disallow” を明示する

- User-Agent 単位でブロックする(GPTBot / ClaudeBot / PerplexityBot など)

- IP レピュテーション + WAF ルールで怪しいアクセスを遮断する

しかし、いずれも「クローラー側が行儀良く守ってくれる」前提か、「検知して即遮断する」反応型です。無視するクローラーや UA を偽装するクローラーには、根本的な抑止力になりません。

AI Labyrinth の新しさは、行儀の悪いクローラーに”偽の成果”を返すことでコストを支払わせるという、インセンティブ設計に踏み込んだ点にあります。

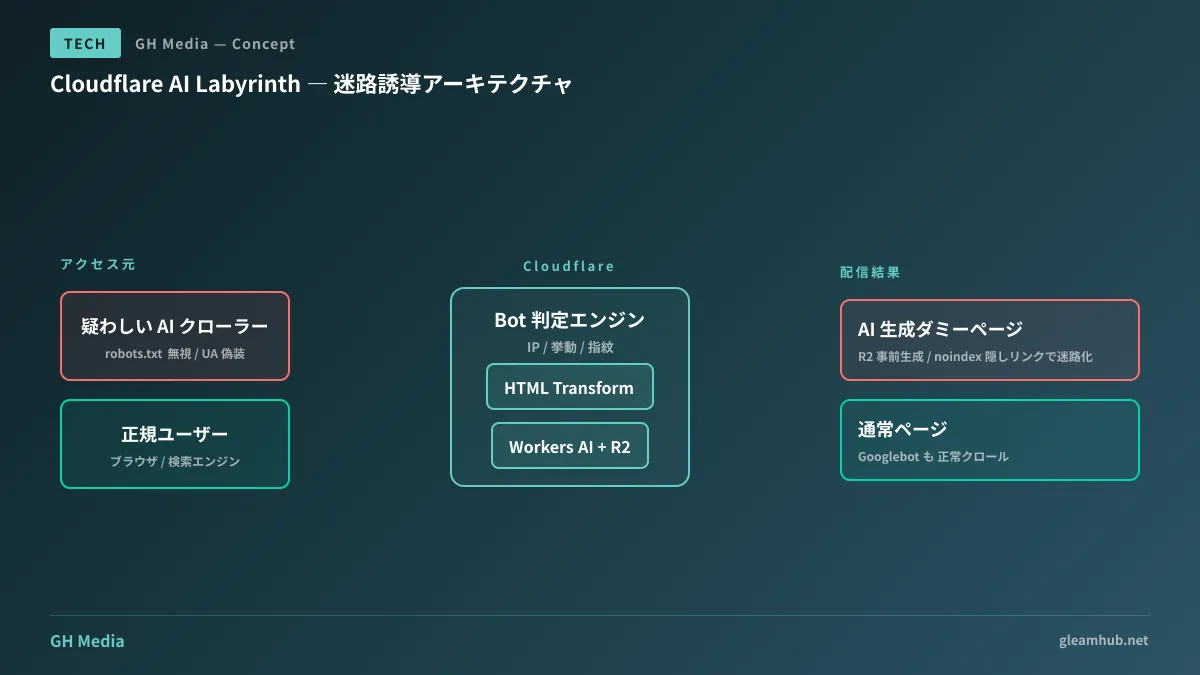

AI Labyrinth の仕組み ― Workers AI + R2 による事前生成パイプライン

公式ブログによると、アーキテクチャは次のように構成されています。

1. ダミーページの事前生成

- Workers AI のオープンソースモデルで、多様なトピックの HTML ページを事前に大量生成

- リクエスト時に都度生成するのではなく、R2 オブジェクトストレージにキャッシュして高速配信

- 生成コンテンツは XSS 対策のためにサニタイズ済み

リアルタイム生成にしなかったのは、レイテンシと推論コストを抑えるためです。クローラー 1 リクエストあたり LLM 推論を走らせると、防御側のコストが跳ね上がります。

2. 隠しリンクの注入

- Cloudflare の HTML トランスフォーム機能で、既存ページに見えないリンクを差し込む

- CSS・HTML 属性で人間の訪問者には表示されない

<meta name="robots" content="noindex, nofollow">相当の指示で検索エンジンにインデックスさせない

ここが重要です。SEO を壊さない設計になっているため、Google や Bing のクロールを阻害しません。

3. クローラーの識別と誘導

- 疑わしいクローラーに対してのみ迷路へのリンクを見せる

- 正規のユーザーや Googlebot 等には通常ページを返す

- クローラーが隠しリンクを辿った時点で、高い確度で自動化されたアクセスと判定できる

4. ハニーポットとしての副次効果

- 人間は AI 生成の無意味なページを何階層も辿らない

- 数階層(目安として 4 階層)深く辿るセッションは、ほぼ確実にボット

- この挙動データが Cloudflare の機械学習モデルの学習材料となり、検知精度が継続的に改善する

有効化の手順 ― ダッシュボードのトグル 1 つ

AI Labyrinth は、コードの追加や DNS 設定変更なしに有効化できるのが特徴です。

- Cloudflare ダッシュボードで対象ドメインを選択

- Security → Bots に移動

- AI Labyrinth トグルをオンにする

これだけで、Cloudflare が判定した疑わしいクローラーに対して自動で隠しリンクが注入されます。Free プランでも利用できるため、まずは検証環境で試して影響を観察する運用が現実的です。

なお、より細かい制御(ボット種別ごとの挙動設定、カスタムルール連携)は Pro 以上のプランで拡張されています。

中小企業のコーポレートサイト・オウンドメディアで何が効くのか

受託開発・内製支援の現場で、中小企業のサイト運用を担当する際の視点から整理します。

効果 1:コンテンツ流用リスクの抑制

多モーダル埋め込みとリランカーで構築する企業 RAG の記事 でも触れたように、自社の一次情報はマーケの差別化資産です。無断学習されて競合の LLM 回答に取り込まれるのは、経営層にとって見過ごせないリスクになりつつあります。

AI Labyrinth は完全に防ぐ技術ではないものの、無視できないコストを攻撃側に支払わせることで、抑止力として機能します。

効果 2:ボット可視化による WAF 運用の精度向上

AI Labyrinth のログは、どのクローラーが、どれだけ深く迷路を辿ったかを記録します。これは従来の WAF ログより意図検知の解像度が高い情報です。

GitHub Code Security で進めるリスク評価の運用手順 と組み合わせれば、コード側の脆弱性管理 × トラフィック側のボット挙動把握 という両輪で、セキュリティ運用の解像度を一段上げられます。

効果 3:クラウド選定の判断材料

Cloudflare 全サービス CLI で加速する AI エージェント最適クラウド選定ガイド で整理した通り、Cloudflare は CDN / WAF / Workers / R2 をワンストップで提供します。

AI Labyrinth のようなエッジ側の高度な防御が Free プランから使える点は、中小企業の受託案件で Cloudflare を第一候補に置く根拠のひとつになります。AWS CloudFront や Fastly と比較したとき、「同等のボット対策を他社で組むといくらかかるか」は、提案書に必ず盛り込みたい比較軸です。

運用で気をつけたい 4 つのポイント

| 観点 | 注意点 |

|---|---|

| SEO | 公式は noindex で保護しているが、有効化後のサーチコンソールで誤クロール警告がないかを数週間観察する |

| 分析ツール | ダミーページへのアクセスが GA4 に混ざらないよう、タグを埋め込まない実装であることを確認 |

| Core Web Vitals | 隠しリンクの注入で HTML 転送量がわずかに増える。LCP/INP への影響を PageSpeed で比較 |

| 法務・広報 | 「AI ボットに誤情報を返している」と解釈されないよう、プライバシーポリシーやボットポリシーに運用方針を記載 |

特に最後の点は、生成 AI 時代のサイト運用ポリシーとして整備すべき項目です。robots.txt に加えて、AI 学習可否を明示する ai.txt や User-Agent ごとの扱いを公開しておくと、検索エンジン側・LLM プロバイダ側の双方に対して筋が通ります。

まとめ ― “攻めの防御” という選択肢

AI Labyrinth は、受動的なブロックから能動的なコスト負担への転換を象徴する機能です。

- コンテンツを生成 AI に無断学習されるリスクを、抑止力として下げられる

- SEO を壊さない設計で、既存のコーポレートサイト・メディア運用に組み込みやすい

- ハニーポットとして検知精度が継続的に改善するネットワーク効果がある

- Free プランから試せるため、検証コストが低い

中小企業のサイト運用・受託開発の現場では、まず検証用の小規模サイトで 2〜4 週間観察し、SEO や Core Web Vitals への影響を確認してから本番適用する流れが無難です。自社メディアの一次情報が増えている会社ほど、導入優先度は高いと言えるでしょう。

「クローラーを遮断する」から「迷路に閉じ込める」へ。インフラレイヤーにおける AI 対策の選択肢が、また一段広がりました。